Llevas una hora explicándole a Claude cómo funciona tu negocio, qué tono quieres en los textos y cuáles son tus clientes objetivo. La conversación fluye. Las respuestas son exactas. Cierras la pestaña satisfecho. Al día siguiente, abres un chat nuevo y Claude te saluda como si nunca te hubiera visto. Todo lo que le explicaste ayer ha desaparecido.

No es un error. Es cómo funciona la arquitectura de los modelos de lenguaje. Pero en 2026, ya existen soluciones reales para que esto deje de pasar.

Para entender por qué Claude "no recuerda", necesitas distinguir dos conceptos que se confunden constantemente:

La ventana de contexto es la memoria de trabajo de Claude. Es el espacio donde Claude procesa todo lo que ocurre dentro de una conversación activa: tus mensajes, sus respuestas, los documentos que subes. En 2026, la ventana de Claude alcanza los doscientos mil tokens (unas ciento cincuenta mil palabras) en planes de pago. Es enorme, pero es temporal — cuando cierras el chat, todo desaparece1.

La memoria permanente es almacenamiento a largo plazo. Es información que persiste entre sesiones distintas: quién eres, en qué proyectos trabajas, qué tono prefieres, qué le dijiste hace tres semanas. Si quieres profundizar en los mecanismos técnicos, consulta nuestra guía completa sobre qué es la memoria permanente para IA.

La confusión entre ambos conceptos es la razón principal por la que los usuarios se frustran. Claude puede mantener una conversación brillante de dos horas, pero al día siguiente no sabe quién eres. No es amnesia — es que nunca tuvo dónde guardar esa información.

Desde marzo de 2026, Anthropic ha desplegado funciones de memoria que cambian significativamente la experiencia. Pero tienen limitaciones que conviene entender antes de confiar en ellas:

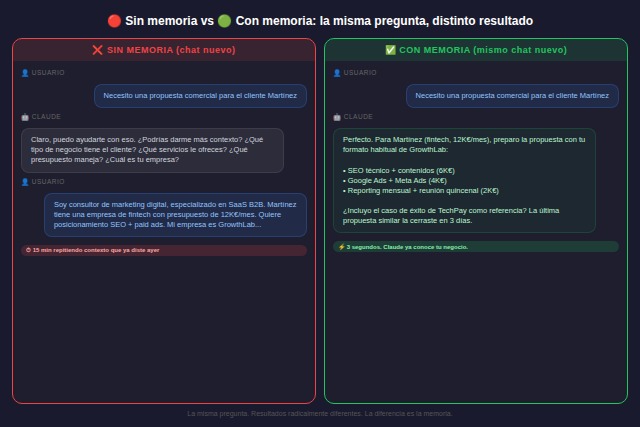

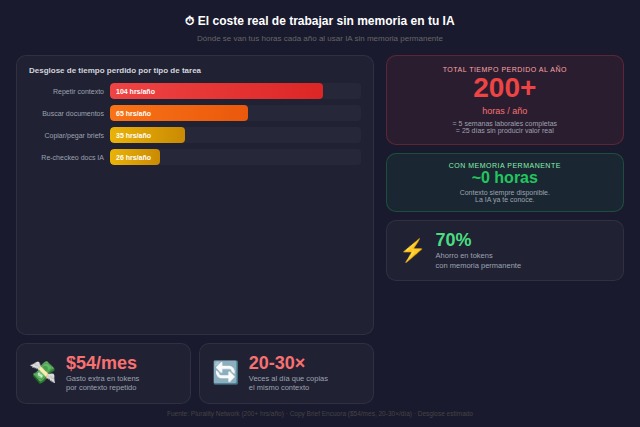

La frustración de "Claude no recuerda" no es solo una molestia — tiene un coste medible. Según datos de Plurality Network, los profesionales que usan IA intensivamente dedican más de doscientas horas al año a reexplicar contexto que ya proporcionaron en sesiones anteriores4. Eso son cinco semanas laborales completas perdidas en repetición.

El impacto va más allá del tiempo. Sin memoria, las respuestas de Claude son genéricas en lugar de específicas. Si Claude no sabe que eres un consultor de marketing especializado en SaaS B2B, te responde como si fueras cualquier persona. Si no recuerda que tu cliente prefiere un tono formal y datos cuantitativos, genera contenido que no encaja. Cada sesión sin contexto es una sesión donde partes de cero, y la calidad de las respuestas sufre.

Para freelancers y consultores, esto se traduce además en un coste económico directo:

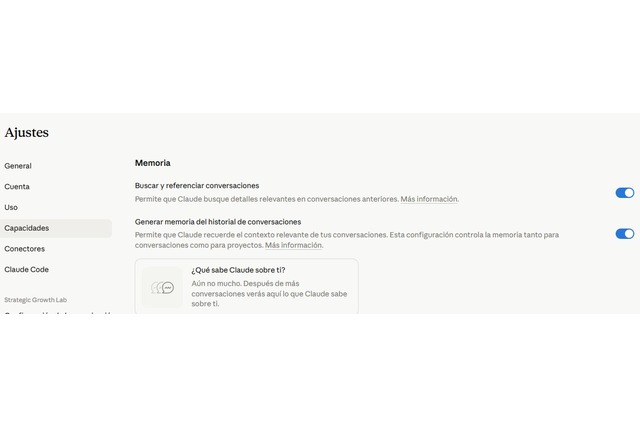

El primer paso es asegurarte de que la memoria está activada. Ve a Ajustes → Capacidades → Memoria y activa ambos toggles:

Esto ya marca una diferencia notable para uso personal.

También puedes decirle explícitamente a Claude qué recordar: "Recuerda que soy diseñador UX, trabajo en una startup de fintech y prefiero respuestas concisas con ejemplos prácticos." Claude añadirá esta información a su síntesis.

Aunque si vas a realizar varias actividades como muchos autónomos y solopreneurs (ejemplo: contabilidad, diseño, desarrollo web, SEO,...) es recomendable que no lo rellenes, para que ese contexto no influya en las respuestas.

Para quién funciona bien: usuarios individuales que usan solo Claude y tienen necesidades de contexto simples.

Los Projects de Claude permiten crear espacios de trabajo con instrucciones persistentes, documentos de referencia y memoria propia por proyecto. Es la forma más estructurada de dar contexto a Claude sin repetirte.

Puedes subir guías de estilo, especificaciones de producto, perfiles de cliente o cualquier documento que Claude necesite como referencia constante.

Cada vez que abres un chat dentro del proyecto, Claude ya tiene todo ese contexto disponible.

Para quién funciona bien: equipos que trabajan exclusivamente con Claude y pueden organizar su trabajo en proyectos definidos.

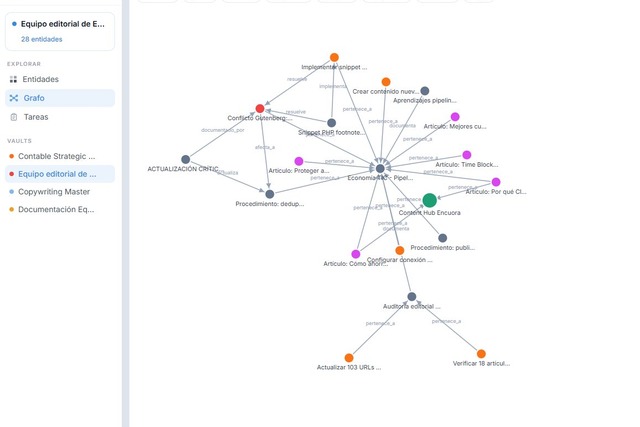

Si trabajas con varias IAs (Claude, ChatGPT) o necesitas un nivel de memoria que Claude no ofrece de forma nativa, Encuora es una herramienta que añade memoria permanente universal a cualquier IA.

Encuora funciona como una capa de memoria externa que se conecta a Claude, ChatGPT y otros LLM simultáneamente vía MCP (Model Context Protocol). Le explicas algo una vez — quién eres, cómo trabajas, en qué proyectos estás — y esa información está disponible en todas tus IAs, en todas las sesiones, sin repetirte nunca más.

La diferencia con la memoria nativa de Claude es que Encuora es independiente de la plataforma. Si mañana cambias de ChatGPT a Claude para un proyecto específico, tu contexto te acompaña. No estás atado a la memoria de un solo proveedor.

Para quién funciona bien: freelancers, consultores y equipos que usan múltiples IAs y necesitan que el contexto fluya entre todas ellas sin fricción.

Que Claude no recuerde por defecto no es un fallo — es una decisión deliberada de Anthropic que responde a consideraciones de privacidad y seguridad. Almacenar las conversaciones de millones de usuarios implica riesgos reales: posibles brechas de seguridad, uso indebido de datos personales y la pregunta de quién tiene acceso a tu información5.

El enfoque de Anthropic es progresivo: ofrecer memoria como opción (no como imposición), dar control al usuario sobre qué se almacena y permitir la eliminación completa de datos. Es un equilibrio entre utilidad y privacidad que cada usuario debe calibrar según su situación.

Lo que está claro es que el mercado se mueve hacia más memoria, no menos. Como señala David Lahoz en su newsletter IA Weekly, la memoria transforma la IA de motor de texto a colaborador continuo — pero esta intimidad digital requiere transparencia, control y ética sin precedentes6.

Solo si activas la función de memoria. Desde marzo de 2026, Claude puede generar una síntesis de tus chats anteriores y usarla como contexto en conversaciones nuevas. Pero viene desactivada por defecto — debes activarla manualmente en Configuración → Capacidades → Memoria.

Ve a Configuración → Capacidades → Memoria y activa los dos toggles: búsqueda de chats anteriores y memoria del historial de chats. La función está disponible en todos los planes, incluido el gratuito. La memoria se actualiza cada veinticuatro horas.

Sí, desde marzo de 2026. Claude incluye una herramienta de importación de memoria que permite transferir historiales de ChatGPT, Gemini y Copilot. El proceso requiere copiar un prompt especial en el otro chatbot, obtener una respuesta con el historial consolidado y pegarla en la sección de importación de Claude.

La memoria es automática y general; Projects es manual y específico. La memoria de Claude sintetiza automáticamente todas tus conversaciones y la aplica a chats nuevos. Projects te permite crear espacios de trabajo con documentos de referencia e instrucciones persistentes para un área concreta. Son complementarios.

No, la memoria nativa de Claude solo funciona dentro de Claude. Si usas varias IAs, necesitas una solución externa como Encuora que conecta memoria permanente a Claude, ChatGPT y Gemini simultáneamente vía MCP.

Claude aplica retención de datos estándar y permite control total al usuario. Puedes ver qué ha memorizado, editar la síntesis, eliminar memorias específicas o desactivar la función completamente. Los chats en modo incógnito nunca se incluyen en la memoria. En planes Enterprise, las políticas de retención de la organización aplican a todos los datos de memoria.

Última revisión: abril 2026