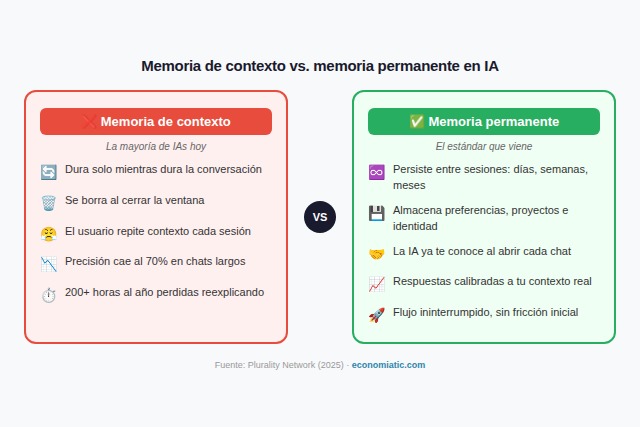

La memoria permanente para IA es la capacidad de un sistema de inteligencia artificial de conservar información entre sesiones de conversación distintas sin que el usuario tenga que repetirla. A diferencia de la memoria de contexto, que desaparece al cerrar la ventana, la memoria permanente persiste días, semanas o meses.

Imagina que contratas a un asistente brillante. El primer día le explicas cómo trabajas, qué proyectos tienes entre manos, qué tono de escritura prefieres, cuáles son tus clientes. Al día siguiente vuelves a la oficina y tienes que explicarle exactamente lo mismo, desde cero. Y al otro día, otra vez. Y así cada vez que abres una conversación nueva.

Eso es lo que le pasa a la mayoría de profesionales que usan IA con memoria hoy —o más exactamente, sin ella. Según datos de Plurality Network, los usuarios dedican más de doscientas horas al año a reexplicar contexto a sus herramientas de inteligencia artificial.1 Son dos horas por semana que no producen nada, solo recuperan el punto de partida.

El problema tiene nombre: amnesia conversacional. Y la solución también: la memoria permanente para IA.

Última revisión: abril 2026

La memoria permanente para IA —también llamada memoria persistente o memoria a largo plazo en IA— es el conjunto de mecanismos que permiten a un sistema de inteligencia artificial almacenar información relevante de una sesión y recuperarla en sesiones futuras, sin necesidad de que el usuario la vuelva a proporcionar.

El concepto se contrapone directamente a la memoria de contexto (o memoria a corto plazo), que es la forma en que funciona la mayoría de IAs hoy: solo recuerdan lo que ha ocurrido dentro de la conversación actual. En cuanto se cierra esa ventana, todo desaparece.

La distinción es importante porque transforma el rol de la IA. Con solo memoria de contexto, la IA es una herramienta puntual: capaz, pero sin historia. Con memoria persistente en IA, el sistema se convierte en un colaborador continuo que aprende quién eres, cómo piensas y qué necesitas.

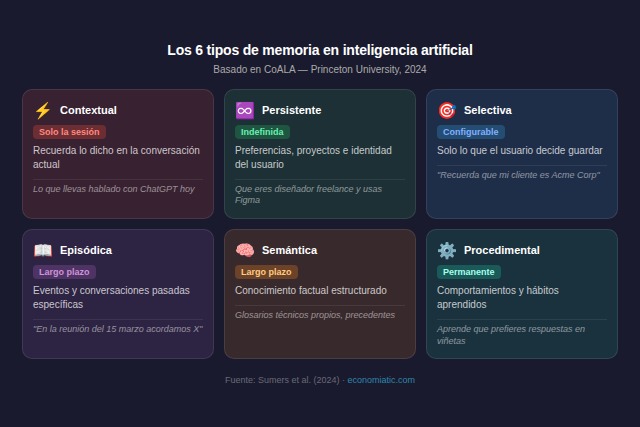

El término técnico de referencia proviene de la arquitectura cognitiva para agentes de lenguaje (CoALA), publicada por investigadores de la Universidad de Princeton en febrero de 2024, que clasifica los sistemas de memoria de los agentes de IA siguiendo los mismos principios que la psicología cognitiva aplica a la memoria humana.2

En la práctica, la memoria permanente para IA significa que cuando abres una conversación nueva con tu asistente, este ya sabe que eres consultor de marketing, que tu cliente principal es del sector salud, que prefieres los textos directos sin jerga y que los lunes tienes reunión de seguimiento.

La memoria permanente no es magia: es arquitectura. Cuando un sistema de IA implementa memoria persistente, lo hace combinando varios mecanismos técnicos que trabajan juntos entre sesiones.

La información que se quiere recordar —preferencias del usuario, contexto de proyectos, datos relevantes— se convierte en representaciones matemáticas llamadas embeddings y se almacena en bases de datos vectoriales. Cuando el usuario inicia una nueva sesión, el sistema busca en esa base de datos la información más relevante para el contexto actual y la recupera automáticamente.

El RAG (recuperación aumentada por generación) es la técnica que conecta la base de datos vectorial con el modelo de lenguaje. En lugar de cargar toda la memoria en el contexto de cada conversación —lo que sería ineficiente y costoso—, el sistema recupera únicamente los fragmentos más relevantes para la consulta concreta del usuario. Es el equivalente a un asistente humano que no memoriza todo, sino que sabe exactamente dónde buscar.

Algunos sistemas organizan la memoria artificial como un grafo: nodos que representan entidades (el usuario, sus proyectos, sus clientes) y aristas que representan las relaciones entre ellas. Esto permite un razonamiento más sofisticado: el sistema puede entender que «el proyecto X» está relacionado con «el cliente Y» y que ambos tienen una fecha límite en marzo.

Herramientas como LangChain y LangGraph permiten a los desarrolladores integrar estos mecanismos de memoria en sus aplicaciones de IA, conectándolos con APIs externas y construyendo flujos de trabajo que persisten entre sesiones.2

Una buena analogía: si la ventana de contexto es la memoria de trabajo de un profesional (lo que tiene en mente mientras hace una tarea), la memoria permanente es su cuaderno de notas, su historial de proyectos y su base de conocimiento personal. Todo guardado y recuperable cuando hace falta.

La investigación en arquitecturas cognitivas para IA distingue al menos seis tipos de memoria, que pueden coexistir en un mismo sistema:

| Tipo de memoria | Duración | Qué almacena | Ejemplo real |

|---|---|---|---|

| Contextual | Solo la sesión actual | Todo lo dicho en la conversación en curso | Lo que llevas hablado con ChatGPT hoy |

| Persistente | Entre sesiones, indefinida | Preferencias, proyectos, identidad del usuario | Que eres diseñador freelance y usas Figma |

| Selectiva | Configurable por el usuario | Solo lo que el usuario decide guardar | «Recuerda que mi cliente principal es Acme Corp» |

| Episódica | Largo plazo | Eventos y conversaciones pasadas específicas | «En la reunión del quince de marzo acordamos X» |

| Semántica | Largo plazo | Conocimiento factual estructurado | Precedentes legales, glosarios técnicos propios |

| Procedimental | Permanente | Comportamientos y habilidades aprendidas | El asistente aprende que prefieres respuestas en viñetas |

En la práctica, los sistemas más avanzados combinan varios de estos tipos. Una IA con memoria solo contextual funciona bien para tareas puntuales pero no acumula nada entre sesiones. Una IA con memoria persistente más episódica puede recordar no solo quién eres, sino también qué se habló la semana pasada.

Aquí está la paradoja de la inteligencia artificial actual: los modelos de lenguaje son cada vez más capaces, pero la mayoría sigue funcionando como si cada conversación fuera la primera. Según datos de Jenova.ai, el noventa y cinco por ciento de las herramientas de IA contemporáneas operan sin estado (stateless): cada sesión empieza desde cero.

¿Por qué? La respuesta está en cómo están diseñados técnicamente.

La ventana de contexto es el espacio de memoria de trabajo de un modelo de lenguaje: todo lo que puede procesar en una sola conversación. Cuando la conversación termina, esa ventana se borra. No hay mecanismo nativo que transfiera información a la siguiente sesión, a menos que el sistema lo implemente explícitamente.

La ventana de contexto también tiene límites prácticos. En conversaciones largas, la precisión del modelo se degrada: investigaciones sobre el rendimiento de los LLMs en contextos extensos muestran que la precisión puede caer del noventa y nueve por ciento al inicio de la conversación hasta el setenta por ciento cuando el contexto se acerca a su límite.3

El resultado es un ciclo frustrante:

Este ciclo no es un fallo de los modelos en sí. Es un fallo de arquitectura: los modelos son potentes, pero no tienen dónde guardar lo que aprenden entre sesiones. La memoria permanente para inteligencia artificial es precisamente la solución a ese problema de diseño.

Un ejemplo concreto: un termostato básico no necesita memoria porque siempre hace lo mismo. Un termostato inteligente sí necesita memoria persistente para aprender los patrones de uso y optimizar el consumo. Del mismo modo, una IA sin memoria siempre es igual de genérica; una IA con memoria se vuelve más útil con el tiempo.2

Para entender el impacto real de la memoria permanente, hay que mirar más allá de la tecnología y preguntarse: ¿qué cambia en el trabajo diario de alguien que usa IA intensivamente? Si ya trabajas con herramientas de mejora de la productividad personal, la IA con memoria es el paso natural siguiente.

Según datos de Plurality Network, los profesionales que usan IA frecuentemente dedican más de doscientas horas al año a reexplicar contexto.1 Eso son dos horas por semana que no producen ninguna entrega, ningún resultado, ningún progreso. Solo recuperan la posición de partida.

Una IA sin memoria persistente da respuestas genéricas. Sabe mucho, pero no sabe nada sobre ti. La diferencia entre «explícame cómo hacer una propuesta comercial» y «ayúdame a estructurar la propuesta para Acme Corp, sabiendo que su presupuesto es limitado y que el decisor es técnico, no de negocio» no está en el modelo: está en el contexto que le das.

Los profesionales que trabajan sin memoria permanente en IA tienen que compensarlo manualmente: guardando prompts en documentos, copiando y pegando contexto al inicio de cada conversación, repitiendo instrucciones de tono y formato. Según datos del Copy Brief de Encuora, este ciclo de copiar y pegar se repite entre veinte y treinta veces al día para usuarios intensivos, con un coste estimado en tokens de cincuenta y cuatro dólares mensuales.

Para un consultor que factura por horas, recuperar dos horas semanales es un impacto directo en la capacidad productiva. Para un freelance que trabaja con varios clientes simultáneamente, tener una IA con memoria persistente que recuerda el contexto de cada uno transforma la herramienta de ayudante genérico en asistente especializado por proyecto. Si además combinas esto con métodos de organización como el time blocking, el resultado en eficiencia es significativo.

La diferencia entre teoría y práctica es donde la memoria artificial demuestra su valor. Estos son escenarios reales documentados:

En todos estos casos, el denominador común es el mismo: la memoria convierte una herramienta potente pero genérica en un colaborador que aprende y mejora con el tiempo. Si trabajas en teletrabajo o gestionas equipos remotos, esta capacidad es especialmente valiosa cuando el contexto de cada proyecto está fragmentado entre múltiples conversaciones y herramientas.

La memoria permanente para IA no es solo una ventaja técnica: introduce también responsabilidades importantes que los usuarios y las empresas deben considerar.

Una IA que recuerda todo también recuerda lo que no deberías haber compartido. Información confidencial de clientes, datos personales, estrategias empresariales sensibles: si están en la memoria del sistema, forman parte de una superficie de exposición más amplia. Una brecha de seguridad en un sistema con memoria persistente en IA tiene consecuencias muy distintas a una brecha en un sistema sin estado.4

Si una IA aprende demasiado de un solo usuario, puede reforzar sus errores, su lenguaje y sus puntos ciegos. La memoria artificial sin equilibrio puede convertirse en una cámara de eco perfectamente educada: una IA que siempre te da la razón porque ha aprendido que eso es lo que esperas.5

Externalizar la memoria a un sistema de IA tiene un coste poco visible: si el asistente recuerda todo por nosotros, tendemos a documentar menos, a ordenar menos nuestras ideas y a memorizar menos los procesos. Como el GPS que funciona perfectamente hasta que se queda sin batería, la dependencia de la memoria artificial puede erosionar la propia capacidad de gestión del conocimiento.5

El RGPD europeo establece el derecho al olvido digital, pero su aplicación práctica en sistemas de IA con memoria persistente es compleja. ¿Puede un usuario pedirle a una IA que olvide de verdad, o solo deja de mostrar lo que sigue almacenado en el servidor?5 Esta pregunta no tiene respuesta técnica sencilla y es uno de los puntos más activos del debate regulatorio bajo el AI Act europeo.

El estándar aspiracional es una memoria controlada por el usuario: visible, editable y revocable. Una memoria que sirva sin poseer.

Existen tres enfoques principales para incorporar memoria permanente en IA al trabajo diario, con niveles muy distintos de flexibilidad y cobertura.

Las principales plataformas de IA han empezado a incorporar memoria persistente de forma nativa. ChatGPT Plus y Pro ofrecen memoria extendida que recuerda el historial de conversaciones a lo largo del tiempo. Claude de Anthropic incorporó memoria generalizada progresivamente desde sus Projects iniciales. Google NotebookLM ofrece memoria documental —recuerda el contenido de tus fuentes— aunque no la identidad del usuario.

Limitación clave: cada plataforma solo recuerda lo que ocurre dentro de su propio ecosistema. Si usas ChatGPT para escribir, Claude para analizar y Gemini para investigar, cada uno parte de cero sin conocer lo que los otros saben sobre ti.

Claude Projects, los espacios de trabajo de ChatGPT y herramientas similares permiten configurar un contexto fijo que se aplica a todas las conversaciones dentro de ese espacio. Es memoria para IA manual y estática: funciona bien, pero requiere que el usuario la gestione activamente y no escala bien cuando los proyectos y clientes son múltiples.

El tercer enfoque son plataformas diseñadas específicamente para añadir memoria permanente a cualquier IA que ya uses, independientemente de la plataforma. Encuora es un ejemplo de esta categoría: actúa como capa de memoria universal que funciona con Claude y ChatGPT simultáneamente (Gemini no soporta MCP todavía), permitiendo que cualquiera de esos modelos acceda al mismo contexto sobre el usuario, sus proyectos y sus preferencias.

La diferencia con los dos enfoques anteriores es la portabilidad: el contexto no queda atrapado en un único ecosistema. El usuario configura su memoria persistente una vez y la lleva consigo independientemente de qué herramienta use en cada momento.

La memoria de contexto es temporal: solo existe durante la conversación en curso y desaparece cuando se cierra. La memoria permanente para IA persiste entre sesiones distintas —días, semanas o meses— sin que el usuario tenga que repetir la información. La primera es la norma actual en la mayoría de IAs; la segunda es lo que permite construir un asistente que realmente aprende sobre ti con el tiempo.

La memoria de contexto es temporal: solo existe durante la conversación en curso y desaparece cuando se cierra. La memoria permanente para IA persiste entre sesiones distintas —días, semanas o meses— sin que el usuario tenga que repetir la información. La primera es la norma actual en la mayoría de IAs; la segunda es lo que permite construir un asistente que realmente aprende sobre ti con el tiempo.

Claude incorporó memoria generalizada entre sesiones de forma progresiva a partir de 2025, con los Projects como punto de partida. Sin embargo, como ocurre con otras plataformas, esa memoria queda confinada al ecosistema de Anthropic. Para tener memoria de Claude accesible también desde ChatGPT o Gemini, se necesitan herramientas de memoria universal como Encuora.

Depende del sistema y de cómo lo uses. Los sistemas de memoria persistente en IA más sólidos cifran los datos en tránsito y en reposo, no los usan para entrenar sus modelos y ofrecen al usuario control total para ver, editar o eliminar lo que se recuerda. Antes de activar la memoria en cualquier plataforma, conviene revisar su política de privacidad y evitar compartir datos especialmente sensibles a menos que tengas garantías contractuales explícitas.

La forma más flexible es usar una herramienta de memoria universal multi-IA, como Encuora, que actúa como capa de contexto compartida entre distintos modelos. Alternativas más manuales son los Projects de Claude o los espacios de trabajo de ChatGPT, aunque estos solo funcionan dentro de cada plataforma. También puedes construir tu propia solución con LangChain si tienes perfil técnico.

La ventana de contexto es el espacio de memoria a corto plazo de un modelo de lenguaje: todo lo que puede procesar y tener en cuenta en una sola conversación. Tiene un límite porque mantener contextos muy largos tiene un coste computacional elevado y porque la precisión del modelo tiende a degradarse en contextos extensos. La ventana de contexto no es memoria permanente: cuando la conversación termina, ese espacio se libera y no queda nada guardado.

Depende de cada plataforma. En los sistemas más transparentes, los datos se almacenan cifrados en servidores del proveedor y el usuario puede consultarlos, editarlos o eliminarlos en cualquier momento. Bajo el RGPD europeo, tienes derecho de acceso, rectificación y supresión de tus datos. La pregunta crítica —que el regulador europeo está empezando a abordar con el AI Act— es si ese olvido es real o solo cosmético.